ChatGPT-4o размаўляе па-беларуску з амерыканскім акцэнтам. Адкуль ён узяўся?

Падобна, што ён перадаўся «генетычна» ад распрацоўшчыкаў. Але як менавіта?

Падобна, што ён перадаўся «генетычна» ад распрацоўшчыкаў. Але як менавіта?

Падобна, што ён перадаўся «генетычна» ад распрацоўшчыкаў. Але як менавіта?

Калі высветлілася, што ChatGPT-4o умее чуць і адказваць па-беларуску, патрабавальныя беларусы пачалі экзаменаваць новую мадэль. Пакуль адны замілоўваюцца, што яна наогул распазнае звернутае да яе маўленне як беларускае і адказвае на той жа мове, іншыя сарамацяць яе за няправільнае вымаўленне. І ўсе разам заўважаюць у ChatGPT дзівосны амерыканскі акцэнт.

@devby.media Chat GPT гаворыць па-беларуску! Але ёсць нюанс — з сакавітым амерыканскім акцэнтам. Вось як гэта гучыць 🤪️️️️️️

♬ оригинальный звук — dev.by

А адкуль ён наогул мог узяцца? Спыталіся ў ML-інжынера Арсеня Краўчанкі і камп’ютэрнага лінгвіста Аляксандра Піперскі.

Для пачатку паспрабавалі зразумець, як наогул уладкаванае вымаўленне ў ChatGPT-4o. Ці гэта простая агучка пісьмовай мовы — такая ж, як, дапусцім, у Google Translate?

Не, не згаджаецца Арсень Краўчанка і адсылае да каментара самой OpenAI. Распрацоўшчыкі тлумачаць, што паслядоўнасць аўдыя-тэкст-аўдыя выкарыстоўвалася раней. Для гэтага ў галасавым рэжыме спалучаліся тры мадэлі: адна транскрыбавала голас у тэкст, другая, уласна GPT-3.5 або GPT-4, прымала тэкст на ўваход і вяртала таксама тэкст, а трэцяя ператварала гэты тэкст зноў у аўдыя. Усё гэта патрабавала ад нейронкі часу і энергіі (насамрэч гублялася шмат інфармацыі), сіл на смех і эмоцыі нібыта проста не заставалася. У новай мадэлі ўсё інакш — яна працэсіць тэкст, аўдыя і карцінкі адначасова ў адной і той жа нейрасетцы. У выніку ўмее і інтанаваць, і нават пяяць.

— То-бок раней speech2text, LLM і text2speech былі асобнымі кавалкамі, а цяпер усё жыве ў адной мадэлі, — вынікуе Арсень.

Гэта значыць, што мадэль генеруе адразу гучанне? А што тады з’яўляецца токенам — не літара, а гук? Ці дзесьці ўнутры мадэлі ўсё ж ёсць пракладка-тэкст?

— Так, мадэль генерыць адразу гук, а токены могуць быць розныя, і яны ўсё «натыўныя». Тэксту ўнутры няма — ёсць вектарнае ўяўленне. То-бок на ўваход паступае рознае (напрыклад, тэкст, карцінкі, гук), яно такенізуецца (ператвараецца ў вектары), потым адбываецца хітрае матрычнае множанне, потым — дэкодзінг, то-бок, па сутнасці, зваротная такенізацыя (а вось яе дэталяў OpenAI не раскрывае, наколькі мне вядома).

Адкуль у беларускай агучцы амерыканскі акцэнт?

Выкажу здагадку, што проста англійскага датасэту ў трэніроўцы было настолькі больш, што ўсім рэдкім мовам (не толькі беларускай) дастаюцца яго артэфакты.

Ці гэтая трэніроўка адбываецца на ўсіх мовах адначасова, ці на кожнай паасобку?

Напэўна невядома, але падазраю, што на ўсіх адначасова.

А адкуль машына бярэ датасэт — ці вучыцца толькі на тым, што ёй даюць, ці, можа, сама знаходзіць у сеціве?

На тым, што даюць распрацоўшчыкі.

Дзесьці ў падрыхтоўцы правільнага датасэту ўтоена шмат крутых сакрэтаў.

Значыць, рэцэпт: «Заліваем у сеціва пабольш якаснага аўдыякантэнту на беларускай мове, і АІ пачынае прамаўляць чысценька», — наўрад ці спрацуе? Прынамсі, не спрацуе напрамую?

Само ў лоб не спрацуе.

Між тым, OpenAI запрашае ўсіх ахвотных паўдзельнічаць у навучанні, адсылаючы свае аўдыякліпы ў сістэму аўтаматычнага распазнавання маўлення Whisper API. Распрацоўшчыкі сцвярджаюць, што сістэма навучаная на 680 000 гадзін рознамоўных даных з інтэрнэту, пры гэтым толькі каля траціны датасэту не на англійскай. Але, здаецца, вашая згода на выкарыстанне аўдыя ў трэніроўцы не гарантуе, што яго не забракуюць.

У той жа час блогеры для навучання ChatGPT беларускай мове раяць папаўняць базу шаблонаў CommonVoice Mozilla.

Кампхютарны лінгвіст Аляксандр Піперскі лічыць, што пытанне пра англійскі акцэнт нейрасеткі цікавы перш за ўсё ў сацыялінгвістычным плане. І рэч не ў аб’ёме беларускага датасэту, а ў тым, наколькі распрацоўшчыкі наогул (не) замарочаныя на акцэнце.

— На рускай ChatGPT-4o таксама размаўляе з відавочным амерыканскім акцэнтам, хоць у гэтым выпадку ўжо сапраўды няма праблем з рэсурсамі для навучання. Дый на беларускай бы іх не было — можна знайсці дастаткова навучальных даных.

Але рэч у тым, што распрацоўшчыкі ChatGPT жывуць у англамоўным свеце, дзе стаўленне да фанетычнай разнастайнасці іншае, чым у беларускай або рускай: для іх акцэнт, па якім лёгка апазнаецца паходжанне таго, хто гаворыць — гэта не нешта няправільнае, ад чаго трэба як мага хутчэй пазбавіцца, а натуральны стан рэчаў. Адпаведна, распрацоўшчыкі разумеюць, што амерыканскі акцэнт у іх галасоў у розных мовах ёсць, але не ўсведамляюць, якое моцнае раздражненне гэта ў нас выклікае, і не ставяць перад сабой мэты неадкладна з гэтым змагацца.

Насамрэч нават тое відэа, якое вы мне даслалі (на ім у ChatGPT пытаюцца пра вядомых беларускіх твітар-юзераў. — devby), паказвае, што сітуацыя ўзаемадзеяння розных моў яшчэ складанейшая. Мы хацелі б, каб у беларускай не было амерыканскага акцэнту, але пры гэтым мы чакаем беларускі акцэнт у англійскіх устаўках у беларускі тэкст: нават калі напісана Twitter лацінскімі літарамі, трэба казаць тўітар/тўітэр/твітар/твітэр/… — варыянты могуць быць розныя, але дакладна не Twitter з паўнавартасным амерыканскім вымаўленнем. А, напрыклад, па-нямецку такія ўстаўкі захоўваюць вымаўленне мовы-крыніцы. Увогуле, ёсць яшчэ што ўдасканальваць нават у такіх дробязях.

Рэлацыраваліся? Цяпер вы можаце каментаваць без верыфікацыі акаўнта.

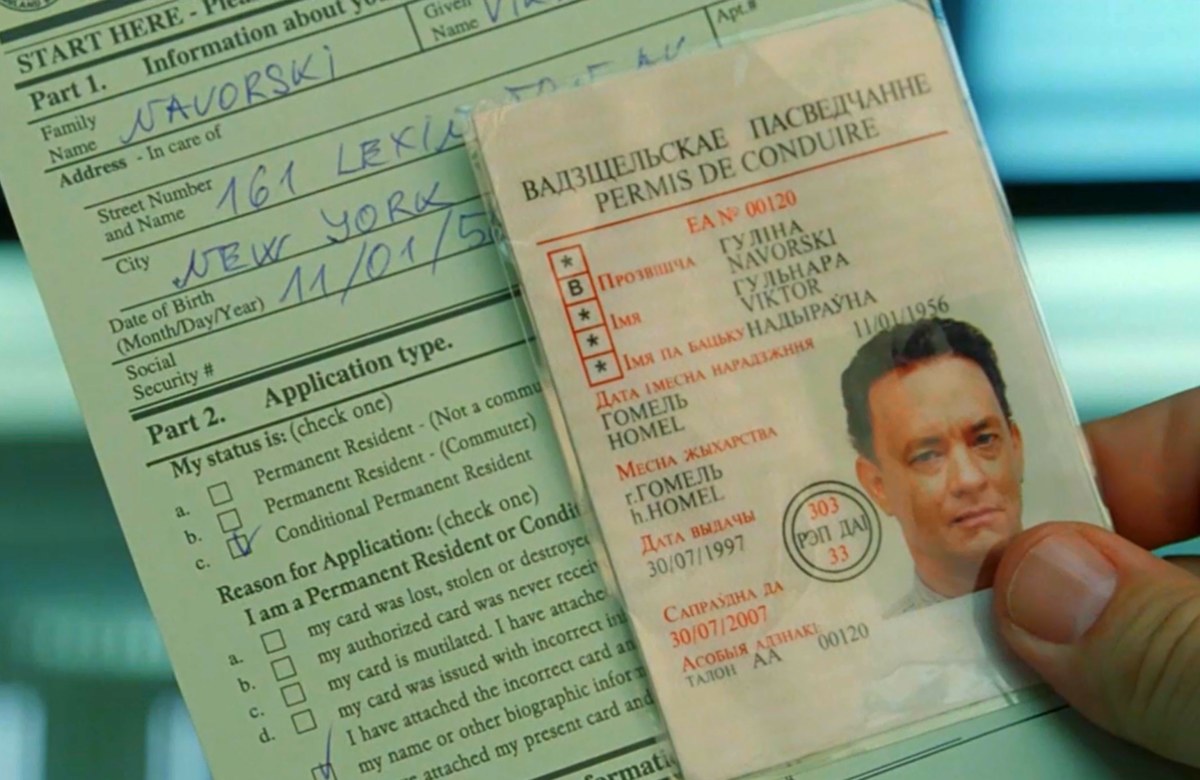

Терминал2 - Виктор становиться в колейку на польской границе с грузом гречки и соли, и стоит на нейтралке полгода, так как в ввоз соли запретили к ввозу и Польша и Кракожия, пока он ждал между таможнями, а выкинуть ничего на нейтралке нельзя.

Проблема в том, что, особенно современный бел.яз. состоит почти полностью из исключений, а модели просто неоткуда было узнать как это всё читается, так же как и неподготовленному читателю.

Хотелки "моуных" всегда умиляют: когда им удобно, они используют вполне английское произношение, а когда им надо выпендриться своей "мовай" то тут вылазят тўітар/тўітэр/твітар/твітэр, хотя никто не хочет говорить іці-навіны.