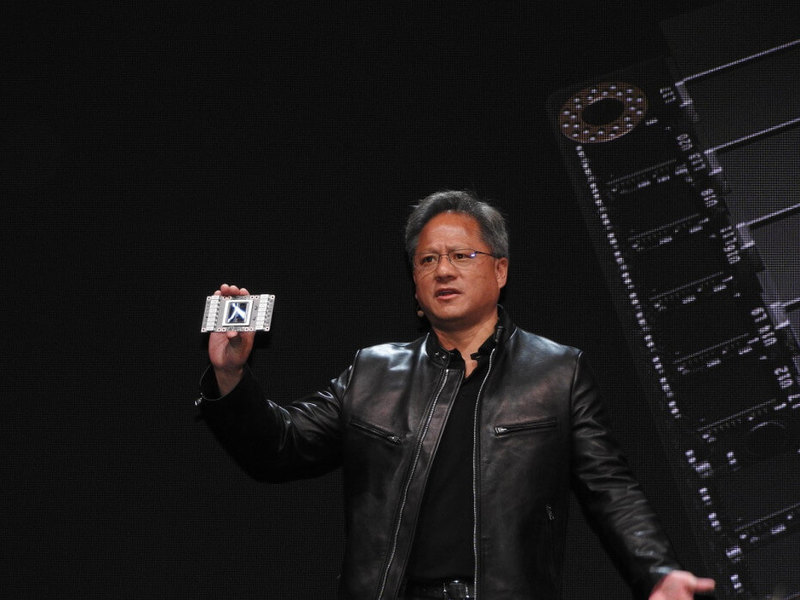

Nvidia представила новый амбициозный процессор для работы с искусственным интеллектом — Tesla V100, сообщает VentureBeat.

Новинка, которую называют также Volta, в 10 раз мощнее и примерно в 3 раза производительнее представленного в прошлом году Pascal с 15 миллиардами транзисторов. Tesla V100 может обрабатывать данные со скоростью 300 гигабит в секунду, в 20 раз быстрее любого другого процессора. В рамках глубинного обучения Tesla V100 способен обрабатывать до 120 терафлопс (триллионов операций с плавающей запятой в секунду).

Всё это позволит «железу» не отставать от потребностей всё более эффективных алгоритмов машинного обучения.

Так, в 2015 году Microsoft создала программу глубинного обучения ResNet — настолько комплексную, что ей требовалась производительность в 7 экзафлопс (квинтиллионов операций с плавающей запятой). Годом позже Deep Speech 2 от Baidu нуждалась уже в 20 экзафлопс, а NMT от Google, созданная в текущем году, имеет потребность уже в 105 экзафлопс вычислительной мощности.

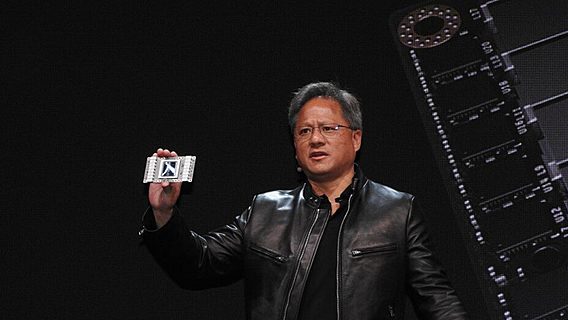

Прежде чем рассказать о новом чипе, CEO Nvidia Жень-Сунь Хуан совершил экскурс в историю искусственного интеллекта.

Он отметил, что первые заметные результаты разработок в области глубокого машинного обучения и нейронных сетей появились около пяти лет назад, когда исследователи начали использовать графические процессоры для параллельной обработки данных. С этого момента начался взлёт Nvidia, основатель которой всегда верил в перспективность видеочипов для искусственного интеллекта, а технологии стали постоянно совершенствоваться.

Релоцировались? Теперь вы можете комментировать без верификации аккаунта.