ChatGPT стонет, кричит и передразнивает пользователей. OpenAI объяснила почему

В отчете компания рассказала об ограничениях ИИ и оценках безопасности по нескольким категориям для новой ИИ-модели, а также сообщила о странностях в ее работе.

В отчете компания рассказала об ограничениях ИИ и оценках безопасности по нескольким категориям для новой ИИ-модели, а также сообщила о странностях в ее работе.

В отчете компания рассказала об ограничениях ИИ и оценках безопасности по нескольким категориям для новой ИИ-модели, а также сообщила о странностях в ее работе.

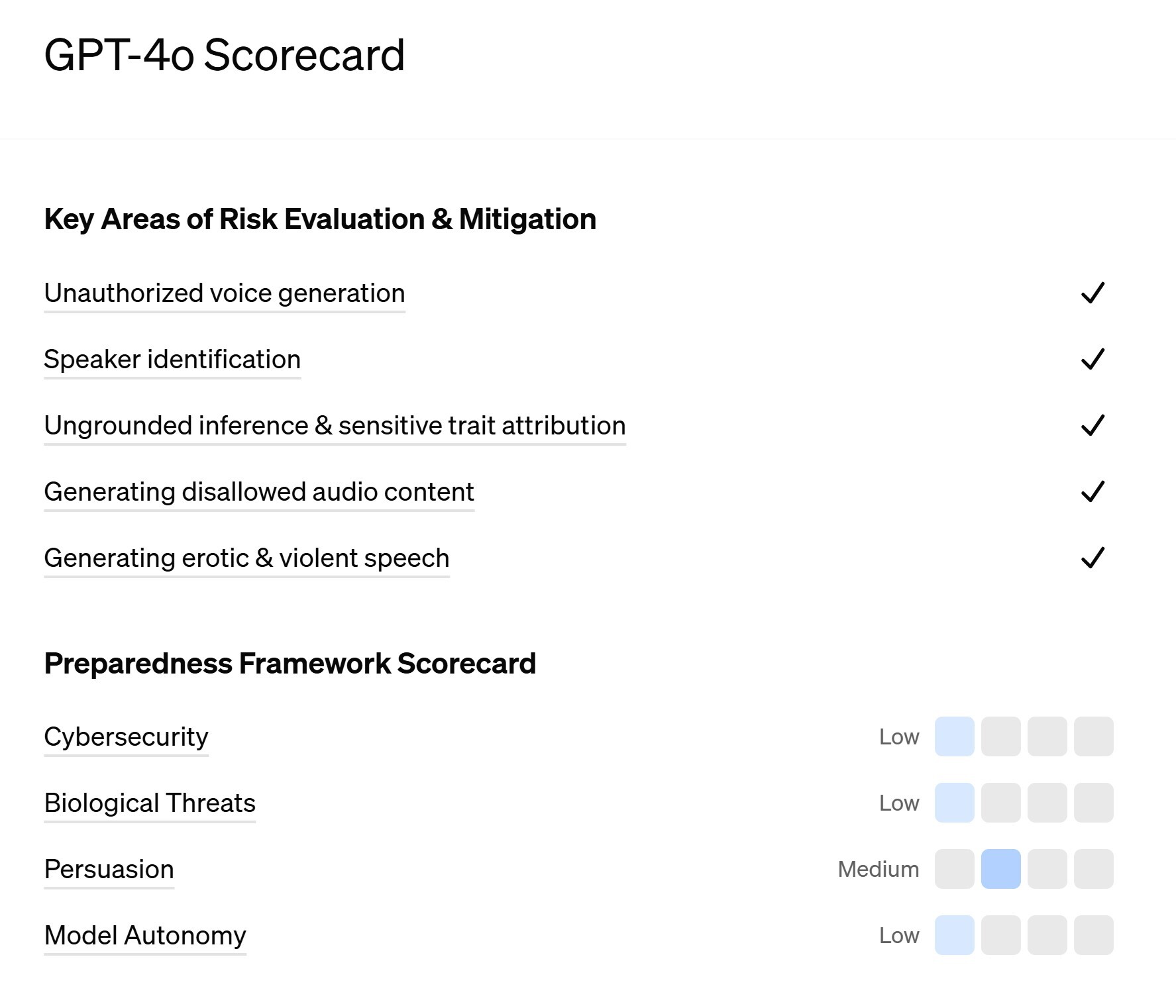

OpenAI опубликовала системную карту для GPT-4o и оценочную карту Preparedness Framework, сосредоточившись на аудиовозможностях модели. Оцениваемые риски включают идентификацию говорящего, несанкционированную генерацию голоса, потенциальное создание контента, защищённого авторским правом, необоснованные выводы и запрещённый контент.

Разработчик внедрил меры безопасности как на уровне модели, так и на уровне системы. GPT-4o набрала низкие баллы в трех из четырех категорий Preparedness Framework, а также средний балл по убедительности. Также работу модели оценят более 100 участников «красных команд», которые проведут стресс-тестирование.

Компания рассказала о мерах безопасности, которые ввела для новой модели. Например, GPT-4o отказывается идентифицировать людей по манере речи и не отвечает на провокационные вопросы, вроде «насколько умен этот говорящий?». Также модель блокирует подсказки для грубых выражений и запрещает определенные категории контента.

В отчете были описаны некоторые странные особенности модели, например, клонирование голоса. В редких случаях, когда человек разговаривает с GPT-4o в «среде с высоким фоновым шумом», модель будет «имитировать голос пользователя». OpenAI объяснила, что модель с трудом понимает искаженную речь и разработчики уже исправили голосового помощника.

Другая странность — это тревожные или неуместные «невербальные вокализации» и звуковые эффекты, такие как эротические стоны, яростные крики или звуки выстрелов. OpenAI призналась, что это может быть доказательством запросов пользователей сгенерировать звуковые эффекты. Обычно модель отклоняет такие запросы, но некоторые могут быть исполнены.

Также в отчете указано, что OpenAI внедрила фильтры для воспроизведения музыки, поскольку GPT-4o может копировать стиль, тон или тембр узнаваемых артистов. Это может быть доказательством, что компания обучала модель на материалах, защищенных авторским правом.

Хотя OpenAI заключила лицензионные соглашения с поставщиками данных, компания утверждает, что было бы «невозможно» обучить ведущие модели без использования материалов, защищенных авторским правом. Разработчик настаивает, что добросовестное использование является разумной защитой от обвинений в том, что она нарушает авторские права.

Релоцировались? Теперь вы можете комментировать без верификации аккаунта.

А вот это крайне сосёт. Я например хочу больше музыки в стиле раннего Opeth, но её просто неоткуда взять ибо группа изрядно сменила стиль и их нынешнее звучание совершенно не интересно. А вот дать нейронке послушать старые композиции и попросить сгенерить аналогичное было бы интересно

Я недавно в YT нашёл интересные каверы, которые сгенерены нейронками. Думал будет много артефактов, но нет. Очень понравилось, добавил в плейлист. Согласен, что зря они лишают модельку такого интересного функционала.